电力与算力:为AI时代重构数据中心架构

作者: CBISMB

责任编辑: 贾西贝

来源: CBISMB

时间: 2026-02-28 10:37

关键字: 伟创力,电力与,算力,AI,数据中心

浏览: 4067

点赞: 219

收藏: 34

作者:

Chris Butler 伟创力关键电源与嵌入式电源事业部总裁

Rob Campbell 伟创力通信、企业和云事业部总裁

在AI数据中心时代,电力与算力基础设施的设计、管理和部署正变得密不可分。电力、算力和冷却组件日益被整合为统一系统,进行统筹规划与优化。然而,由于AI工作负载对高密度计算机架的需求,电力组件必须进行“解耦”处理,既为高密集堆叠的服务器腾出空间,又要以远超以往的效率输送更多电力。仅从额定功耗来看,一个兆瓦级的GPU机架产生的热量约是满载CPU机架的50倍。

“侧挂车”模式应运而生

由开放计算项目(OCP)开发的Open Rack v3(Orv3)标准旨在支持更高功率密度,并在灵活、可扩展的机架中实现液冷等先进功能,以适应不断发展的AI和高性能计算(HPC)工作负载,同时兼容各种IT设备。在这一标准下,每个集成机架均可视为一个每个集成机架均可视为一个独立“单元”。但兆瓦级机架的出现,正在打破这一传统范式。

ORv3机架最初设计的单架功率支持范围为18千瓦至36千瓦,至今仍是众多工作负载的行业标杆,但已无法满足即将普及的兆瓦级机架需求。1兆瓦IT机架的设计规划已超出标准ORv3标准的极限,这不仅需要对原有设计进行大幅调整,还需采用“侧挂车”来应对电力和冷却需求。

正因如此,一些超大规模数据中心运营商正联合起来,在开放计算项目(OCP)的支持下共同开发Mt. Diablo标准,例如全新的电力机架规范,该规范支持高压直流供电基础设施和每机架1兆瓦的IT负载,并通过将电力、冷却和IT设备解耦,进一步提升各项功能的利用率。与以往单个机架独立运行不同,如今冷却液分配单元(CDU)、电力分配单元(PUD)和IT机架(一个或多个)共同构成支撑工作负载的集合单元,而冷却液分配单元(CDU)和电力分配单元(PUD)就成了IT机架的“侧挂车”。伟创力全新推出的AI基础设施平台便是绝佳例证,它将电力、冷却与计算整合到预先设计的模块化参考方案中,专为下一代数据中心量身打造。

“围墙”正在倒下

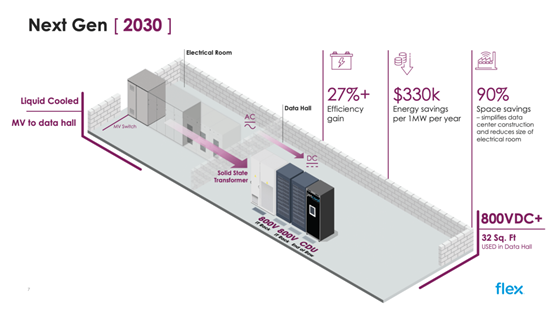

随着数据中心转向采用更高电压和先进的液体冷却技术来支持1兆瓦机架,电力转换、电力分配以及风冷环境所需设备的占用空间将大幅缩减。

一场彻底的变革正在发生,未来十年内将全面重塑人工智能数据中心基础设施。独立的电源柜和冷却液分配单元(CDU)将为IT机架释放出更多计算空间,这意味着处理工作负载所需的IT机架数量更少、密度更高、性能更强。此外,"侧挂车"可以同时为多个专用计算机架供电和散热,无需再为每个机架配备独立的电力和冷却系统。这将释放出更多空间,为后续的创新提供广阔的空间。

随着IT机架、电力和冷却单元变得更加集中、强大和高效,分隔“灰色空间”(电力机房)与“白色空间”(数据大厅)的“围墙”正逐渐消失,这种转变意义深远。据我们估计,下一代数据中心仅需当前10%的空间,就能实现同等的算力输出,且效率更高。

超大规模数据中心运营商将如何利用这些新增的可用空间?他们很可能会选择提升千兆级数据中心的计算密度,但这还有待观察。不过可以确定的是,既然更小空间内能实现更多功能,他们也可能选择缩减数据中心规模,降低建设资本支出。无论选择哪条路径,这场变革既是发展的助推器,也是全新机遇。我们热切期待与行业伙伴携手合作,共同推动AI时代的基础设施创新以及相关产品研发。我们大胆预测:即使AI时代数据中心对电力、算力和冷却的需求持续攀升,仍能实现更高的运营效率、更低的运营成本和更强的系统韧性——这无疑是一场极具积极意义的变革。