DeepSeek联合清华北大发布针对智能体的推理系统DualPath

作者: CBISMB

责任编辑: 宋慧

来源: CBISMB

时间: 2026-02-28 14:23

浏览: 3646

点赞: 188

收藏: 22

DeepSeek 联合清华大学与北京大学在 2026 年 2 月发布了一篇重磅技术论文,标题为 《DualPath: A Dual-Path Loading Framework for Agent Reasoning》(中文译名:《DualPath:一种针对智能体工作负载的大模型推理系统》)。

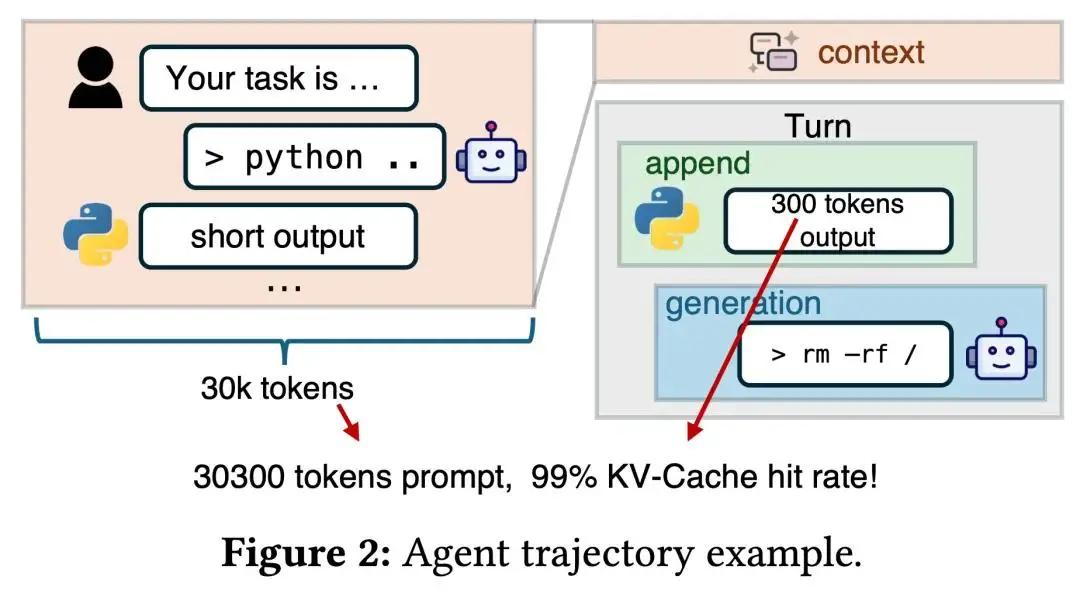

总结来说,这篇新论文介绍了一个名为「DualPath」的创新推理系统,专门针对智能体工作负载下的大语言模型(LLM)推理性能进行优化。具体来讲,通过引入「双路径 KV-Cache 加载」机制,解决了在预填充 - 解码(PD)分离架构下,KV-Cache 读取负载不平衡的问题。

该推理系统带来了显著效果:在离线推理场景中实现了 1.87 倍的吞吐量提升,在线服务场景下实现了 1.96 倍的服务吞吐量提升。

核心亮点与创新

这篇论文聚焦于当前 AI 大模型在 智能体(Agentic AI) 场景下的推理效率问题,提出了被称为 “DualPath” 的新型推理框架。

解决 I/O 瓶颈:在多轮对话或复杂任务中,模型需要频繁读取大量的 KV-Cache(键值缓存),导致 GPU 大部分时间在等待读取,算力无法发挥。DualPath 通过引入“双路径”机制,重新设计 KV-Cache 的加载逻辑,有效缓解了这一瓶颈。

性能提升显著:

离线推理:吞吐量提升了 1.87 倍。

在线服务:每秒智能体运行数提升了 1.96 倍。

技术实现:利用了集群中闲置的网络带宽(如 RDMA 网络),将 KV-Cache 加载任务从计算节点(计算节点)转移到存储节点(存储节点),实现了存储带宽的全局池化与动态负载均衡。

论坛作者与发布机构

第一作者:吴永彤(北京大学博士生)。

合作机构:DeepSeek 团队、清华大学、北京大学。

研究方向:大模型基础设施优化、智能体推理效率。

研究意义

该论文被视为中国大模型从“拼参数、堆算力”转向“拼效率”的代表作之一,标志着 DeepSeek 在工程化优化和软硬件协同设计方面取得了关键突破。

简而言之:这篇论文不仅在学术上提出了新的系统架构 DualPath,也在实际应用中显著降低了AI 智能体的运营成本,为大模型的商业化落地提供了重要的底层技术支撑。